73%的CISO更倾向于考虑采用AI赋能的安全解决方案

越来越多的安全高管将人工智能视为提升安全运营能力的关键手段。然而,专家同时警告称,在安全产品中仓促引入AI,也可能带来一系列新的风险与隐患。

01

CISO 正加速拥抱 AI 赋能的安全技术

首席信息安全官(CISO)正加速采用AI赋能的安全技术,以强化组织的网络防御能力,并扩展安全团队的作战半径。

根据Foundry最新发布的《安全优先事项研究报告》,目前已有73%的安全决策者表示,更有可能考虑采用包含人工智能能力的安全解决方案,这一比例较上一年度的59%显著提升。

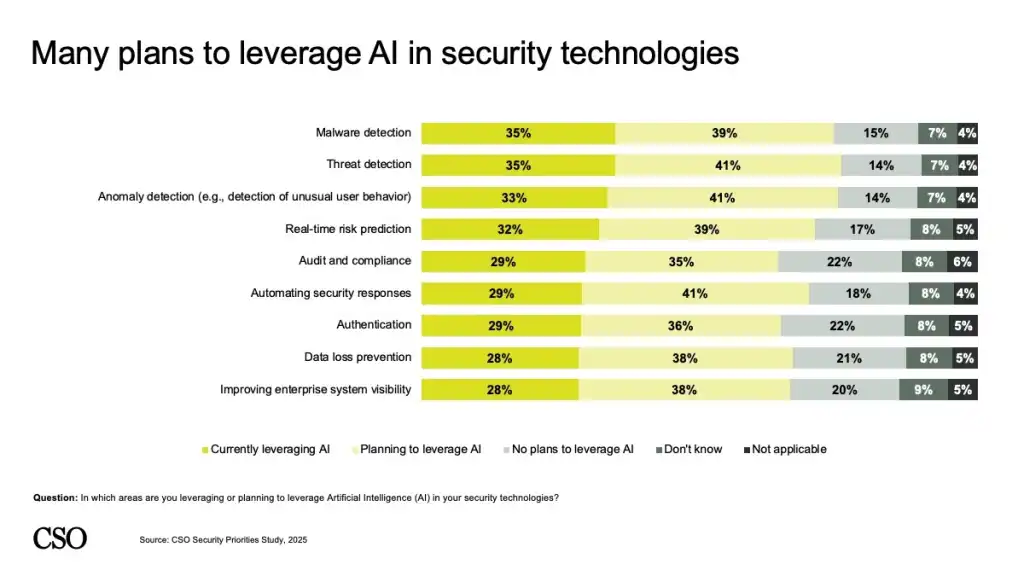

在具体应用层面,CISO计划将AI用于多种安全职能,包括恶意软件检测、威胁检测、异常行为识别、实时风险预测以及审计与合规等领域。同时,AI也被寄予厚望,用于自动化安全响应、身份认证、数据防泄露(DLP)以及提升企业整体系统可视性。

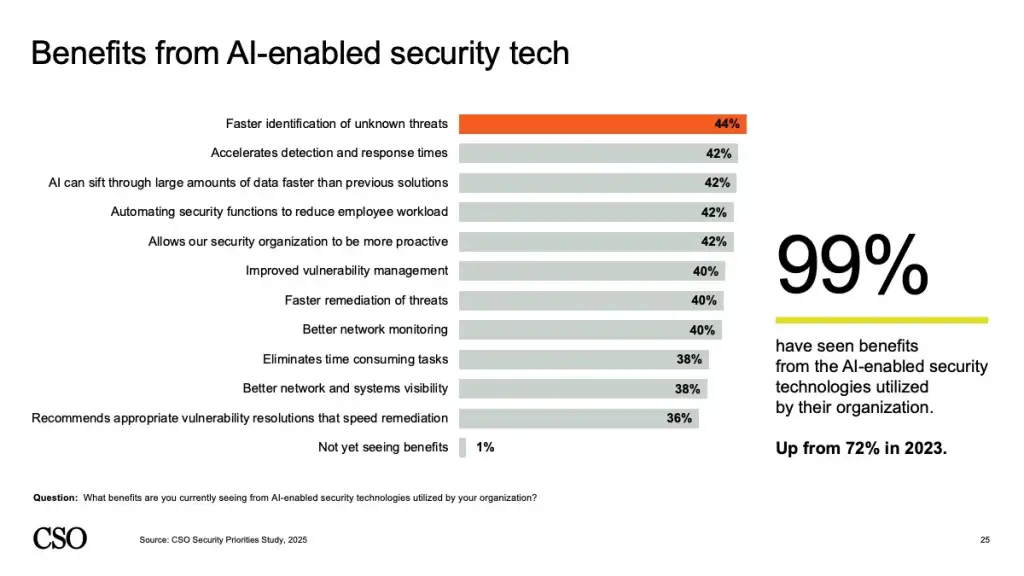

调查受访者普遍认为,AI能够带来多方面的实际收益,例如更快地识别未知威胁、显著缩短响应时间,以及通过自动化安全任务来降低员工的工作负担。这一趋势也与普华永道在2025年10月发布的一项研究结论相一致。该研究指出,在未来12个月内,AI已超越云安全和数据保护,成为企业网络安全投资的首要方向。

不过,如何在喧嚣的市场宣传中做出理性判断、确保AI安全投资真正产生预期效果,依然是摆在安全领导者面前的一道难题。多位接受《CSO》采访的专家表示,在未来12至18个月内,安全负责人确实应优先考虑将AI投入到异常检测、身份与访问管理强化以及响应自动化等关键领域,但同时也必须警惕AI幻觉、对AI的过度依赖以及治理机制缺失等潜在问题。

02

从“噪声”中提取真正有价值的信号

网络韧性厂商Halcyon的首席战略官、同时也是巴克莱银行前CISO的Oliver Newbury向《CSO》表示,AI在安全领域最具价值的应用场景,是那些能够提升可视性、减少无效噪声的能力。

在安全事件持续演化的过程中,团队迫切需要更清晰的信号、更早的预警,以及更快通向确定性结论的路径。“能够从海量活动中筛选关键信息、识别有意义的模式,并以分析人员可以立即采取行动的方式呈现结果的AI,才是真正能为组织带来价值的AI。”

Newbury补充说,这类能力可以显著缩短调查时间,并在高压情境下支持更快速、更有信心的决策。

许多安全专家认为,单纯依靠人工主导的方式,已经不足以应对当前威胁数量与复杂度的持续上升。战略性地使用AI技术,有助于识别攻击模式,帮助分析人员有效过滤噪声、做出更高质量的判断,从而释放时间和资源,用于更高价值的安全工作,摆脱长期“救火式”的被动防御状态。

安全团队普遍处于超负荷状态,问题并不在于工具不足,而在于缺乏时间和清晰的判断依据。“AI真正体现价值的地方,在于那些速度和模式识别能力明显优于人工的场景,例如行为异常检测、早期威胁迹象识别,以及往往先于勒索软件事件发生的细微身份相关活动。”

03

警惕“交付能力”与“AI标签”之间的错位

技术咨询公司Outlier Technology创始人David Tyler提醒称,一些厂商只是给既有能力贴上“AI”的标签,同时抬高价格,而真正实现扎实产品演进和技术突破的厂商并不多。

市场上许多被宣传为“突破性AI”的能力,实际上是存在了数十年的技术,只是最近才被更好地实现和落地。这本身并非坏事,因为优秀的产品管理与工程落地,与算法创新同样重要。但如果某家厂商的“AI安全解决方案”是在过去一两年内突然出现的,那么它很可能只是重新包装,而非真正的能力建设。

Tyler认为,首席安全官在评估供应商时,应重点关注其在相关能力上的长期投入历史,以及产品演进路径。“那些在图关系分析、自适应基线建模、行为分析等方向深耕十年的厂商,与仅仅在用户界面中加入一个AI聊天功能、就宣称实现创新的厂商,存在本质区别。”

应用安全厂商Black Duck研发高级经理Andrew Bolster博士也对“在数据基础薄弱的情况下强行叠加AI”的做法提出警告。他指出,任何AI能力的效果,最终都取决于底层数据质量。

“所谓AI驱动的身份认证系统,其效果取决于身份数据本身的卫生状况;AI驱动的恶意软件检测能力,也取决于样本库的质量以及标签的准确性。”Bolster强调,在签署AI安全平台采购合同之前,企业应首先审视自身的数据治理成熟度。

此外,他还认为,CISO本身应将更多精力放在构建“AI就绪”的安全数据平台上,而不是简单比较要购买哪一款安全工具。

安全负责人应投资于数据网格(Data Mesh)架构,将安全遥测数据视为一类“一级数据产品”,明确其所有权、质量服务级别协议(SLA)以及统一的数据标准。

04

构建真正可持续的AI安全平台,而非堆砌工具

托管安全服务提供商Cybanetix的运营总监Merlin Gillespie认为,AI安全市场正在逐步成熟,并从单点解决方案转向更加一体化的平台模式。但他同时指出,这一转变也给安全领导者带来了新的挑战。

如今几乎每一款安全工具都带有一层AI“辅助”能力,但这种堆叠并未真正简化运营,反而导致工具重叠、报告口径不一致以及数据来源不清晰等问题。“经验教训在于,贴着AI标签的工具确实有用,但它们本身并不能构成完整解决方案。”

Gillespie认为,大多数组织面临的核心任务,是明确哪些流程适合自动化,以及哪些流程能够真正从AI的确定性和推理能力中受益。

安全团队应采用与企业其他业务领域相同的自上而下分析方法,来提升软件和人员效率,而不是被厂商工具牵着走,否则只会进一步加剧安全体系的碎片化。

05

AI安全落地过程中的关键风险

Halcyon的Newbury强调,在部署AI系统时,潜在风险远不止上述问题。其中一个重要隐患,是对AI的过度依赖可能反而放大整体风险。

AI不应取代资产管理、补丁管理、身份治理、网络分段或灾难恢复演练等基础安全能力。“随着攻击者加速采用AI,这些基础能力反而变得更加重要。”

此外,AI系统在训练阶段继承的缺陷,也可能在实际应用中造成严重问题。

如果模型基于狭窄或不现实的数据集进行训练,就很容易形成盲区。因此,CISO必须清楚模型是如何训练的,以及其假设在什么场景下会失效。

Newbury认为,勒索软件攻击是检验AI安全投资是否投入到正确方向上的最直观试金石。

当前大多数现代勒索软件事件,本质上都是以身份为核心的攻击。“攻击者往往不是‘攻破系统’,而是直接‘登录系统’。”他表示,这些攻击通常伴随着通过信息窃取程序大规模获取的凭证。

他进一步指出,随着对手将AI深度融入其攻击流程,这类攻击将来得更快、破坏性更强,使组织韧性问题变得更加紧迫。

最终,Newbury总结道,AI确实值得投入,但前提是它能够帮助安全团队提升决策质量、降低噪声,并为团队赢得在问题演变为危机之前采取行动所需的时间与清晰判断力。