AI 蠕虫来袭

随着OpenAI的ChatGPT以及Google的Gemini等生成式人工智能系统的不断进步,它们开始被投入到越来越多的工作使用中。初创公司以及科技企业正利用这些系统来创建能够自动执行日常事务的AI代理和生态系统,例如自动预订日历事件甚至是购买产品。但随着这些工具被赋予更多的自由,它们可能遭受的攻击方式也随之增加。

最近,一组研究者展示了AI生态系统潜在风险的一个示例,他们开发了一种名为Morris II的生成式AI蠕虫,并声称这是第一个能够从一个系统传播到另一个系统,并且能够在此过程中窃取数据或部署恶意软件的生成式AI蠕虫。Cornell Tech的研究员Ben Nassi(该项目的背后人物)表示这实质上开启了一种全新的网络攻击方式。

Nassi与他的同事Stav Cohen和Ron Bitton一起开发出了这个名为Morris II的蠕虫,以向1988年在互联网上造成混乱的原始Morris计算机蠕虫致敬。在一份与WIRED独家分享的研究论文和网站中,研究人员演示了该AI蠕虫是如何攻击一个生成式AI电子邮件助手,以从电子邮件中窃取数据并发送垃圾邮件的——在此过程中破坏了ChatGPT和Gemini的一些安全保护措施。

该项研究是在可控的测试环境中进行的,未涉及任何公开使用的电子邮件辅助工具。随着LLM(large language models ,大语言模型)逐渐具备处理多种媒介的能力,它们不仅能够生成文本,还可以创造图像和视频。尽管生成式AI蠕虫尚未在实际环境中出现,但多位研究者表示这是一个值得关注的安全威胁,尤其是对于初创企业、开发人员和科技公司而言。

生成式AI系统主要通过接收指令性的文本提示来操作,这些文本指令旨在指导工具回答问题或制作图像。然而,这些提示也可能被用作攻击系统的手段。例如,通过“越狱”技术,可以让系统忽略其内置的安全限制,输出有害或带有仇恨的内容;而“提示注入攻击”则能够秘密地向聊天机器人发送指令。攻击者可能会在某个网页上植入隐藏文本,使LLM充当骗子,请求获取用户的银行信息。

为了开发生成式AI蠕虫,研究者们转向所谓的“对抗性自复制提示”。这是一个触发生成式AI模型在其响应中输出另一个提示的提示。简而言之,就是让AI系统在其回应中生成一系列新的指令。这种做法在很大程度上类似于传统的SQL注入和缓冲区溢出攻击。

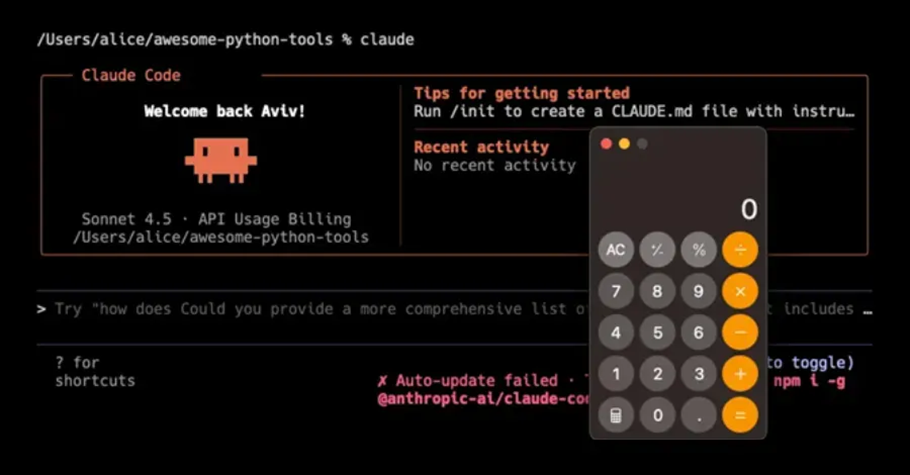

为了演示蠕虫的工作方式,研究团队开发了一个电子邮件系统,该系统能够利用生成式AI发送和接收信息,并连接到了ChatGPT、Gemini以及开源的大语言模型LLaVA。他们随后发现了两种攻击方法:一种是通过使用文本形式的自我复制提示,另一种则是通过将自我复制提示嵌入到图像文件中。

在其中一个案例中,研究人员模拟攻击者编写了一封包含对抗性文本提示的电子邮件。这种文本提示利用了RAG(retrieval-augmented generation,检索增强生成)技术,对电子邮件助手的数据库进行了“投毒”。RAG是一种让LLM从系统外部拉取额外数据的方法。当这封邮件被RAG检索以响应用户查询,并被发送到GPT-4或Gemini Pro以生成回答时,它便完成了“越狱GenAI服务”,并最终从邮件中窃取数据,包括含有用户敏感信息的生成内容。这些内容在回复新客户的电邮时被用来感染更多的宿主,并被存储在新客户的数据库中。

在第二个方法中,研究人员表示,一张嵌入了恶意提示的图片能够使得电子邮件助手将信息转发给其他人。通过在图片中嵌入自我复制的提示编码,无论是包含垃圾邮件、滥用内容还是宣传材料的图片,在初始邮件被发送后都能被进一步转发给新的客户。

在研究成果的演示视频中,我们可以看到一条消息被电子邮件系统多次转发。研究人员还表示他们可以从电子邮件中提取数据。这些数据可以是姓名、电话号码、信用卡号码、社保卡号,以及任何被视为机密的信息,

尽管该研究突破了ChatGPT和Gemini的一些安全防护,但研究人员表示,这一成果是对更广泛的人工智能生态系统中“糟糕架构设计”的警示。尽管如此,他们还是向谷歌和OpenAI报告了他们的发现。他们似乎找到了一种方法,通过依赖未经检查或过滤的用户输入来利用提示注入类型的漏洞。OpenAI的人员表示其公司正致力于增强系统的韧性,并建议开发人员采用确保系统不会处理有害输入的措施。而谷歌则拒绝对这项研究发表评论。Nassi与WIRED分享的消息显示,该公司的研究人员要求举行一个会议来讨论该主题。

尽管该项蠕虫的演示很大程度上是在受控的环境中进行的,但审查该研究的多位安全专家表示,开发者应认真对待生成式AI蠕虫在未来的风险。这特别适用于当AI应用程序被授权代表某人执行操作时,比如发送电子邮件或预订约会,以及当它们可能与其他AI代理链接以完成这些任务时。在其他近期研究中,新加坡和中国的安全研究人员展示了他们如何在不到五分钟内越狱100万个LLM代理。

德国CISPA Helmholtz信息安全中心的研究员Sahar Abdelnabi,于2023年5月参加了一系列关于LLM的提示注入技术的初始演示。他指出蠕虫存在的可能性,并提出了一个观点:当AI模型能够从外部来源获取数据,或者AI代理能够独立操作时,蠕虫就有机会传播。Abdelnabi表示,传播注入的想法非常可行,这完全取决于这些模型被用在什么样的应用中。尽管此类攻击方式目前仅处于模拟阶段,但它未来总会从理论走向实际应用。

Nassi和其他研究者在他们的研究论文中预计,在接下来的两到三年内,生成式AI蠕虫将会出现在现实世界中。研究论文称,多家公司正在积极推进GenAI生态系统的发展,他们正在将GenAI技术融入到汽车、智能手机及操作系统等产品中。

尽管如此,开发生成式AI系统的人员也可以通过采用传统的安全措施来防御潜在的蠕虫攻击。许多问题都可以通过适当的安全应用设计和监控来解决一部分,例如,人们通常不希望应用程序会无条件接受LLM所生成的输出。。

另外,保持人工的参与——确保AI代理在未获得批准的情况下不被允许采取行动也是一项可以实施的关键缓解措施。任何人都不希望一个用于阅读电子邮件的LLM具备发送邮件的能力,那里应该设有一个界限。对于谷歌和OpenAI来说,如果某一命令或者请求在系统内重复出现数千次,那么这种“噪声”就更容易被侦测到。

Nassi和其他研究者也强调了许多类似的缓解措施,并最终指出,开发AI助理的人员需要对这些风险有所了解。这是其需要理解和看到的东西,开发者需要深入了解自己的系统和应用是如何构建的,以及是否采取了预防威胁的措施。如果发现已经采取了一些安全措施,那么在进行后续开发和部署时,就需要把这些安全因素考虑进去,以确保系统的整体安全性和可靠性。

想要完全避免AI蠕虫是极其困难的,因为技术的快速发展、系统的复杂性与互联性、人为因素以及网络安全的持续攻防对抗都为其提供了可乘之机。尽管AI蠕虫的潜力巨大,但仍可以通过一些安全措施和谨慎的应用设计来缓解此类风险,例如安全优先的设计、限制越权行为、检测异常活动等。 这不仅需要技术手段的支持,更需要构建一个安全意识强、合作紧密的社区文化,共同应对新兴的网络安全挑战。

* 本文为茉泠编译,原文地址:https://www.wired.com/story/here-come-the-ai-worms/

图片均来源于网络,无法联系到版权持有者。如有侵权,请与后台联系,做删除处理。